Nossa abordagem à IA generativa é fundamentada no profundo respeito à criatividade humana. Uma IA projetada para apoiar, não substituir, e baseada no compromisso com a inovação responsável, colocando os criadores em primeiro lugar.

Na Chaos, acreditamos que a IA não veio para substituir a criatividade humana, mas para aprimorá-la. Nossas ferramentas de IA são desenvolvidas para auxiliar arquitetos, engenheiros, empreiteiros e artistas visuais, oferecendo recursos que potencializam a imaginação e a eficiência e, ao mesmo tempo, protegem a autoria e a originalidade.

Com a IA generativa transformando-se em equipamento de design e visualização, reforçamos nosso compromisso: impulsionar a inovação sem fazer concessões, respeitando criadores, protegendo a propriedade intelectual e proporcionando transparência ética e jurídica em cada etapa.

Projetamos nossa IA como plataformas de cocriação, colocando profissionais no controle enquanto aproveitam todo o potencial da IA. Ela é feita para potencializar a criatividade, não suprimi-la.

Veja aqui como garantimos que nossa abordagem permaneça ponderada, responsável e centrada nos criadores:

O Veras and Chaos AI Enhancer usa o Stable Diffusion, que foi treinado com pares de imagens e legendas tirados do LAION-5B, um conjunto de dados disponíveis publicamente derivado de dados de Common Crawl coletados da Web. Para outros modelos, só usamos conjuntos de dados que tenham código aberto e sejam adequados ao uso comercial ou sejam licenciados corretamente para o nosso uso.

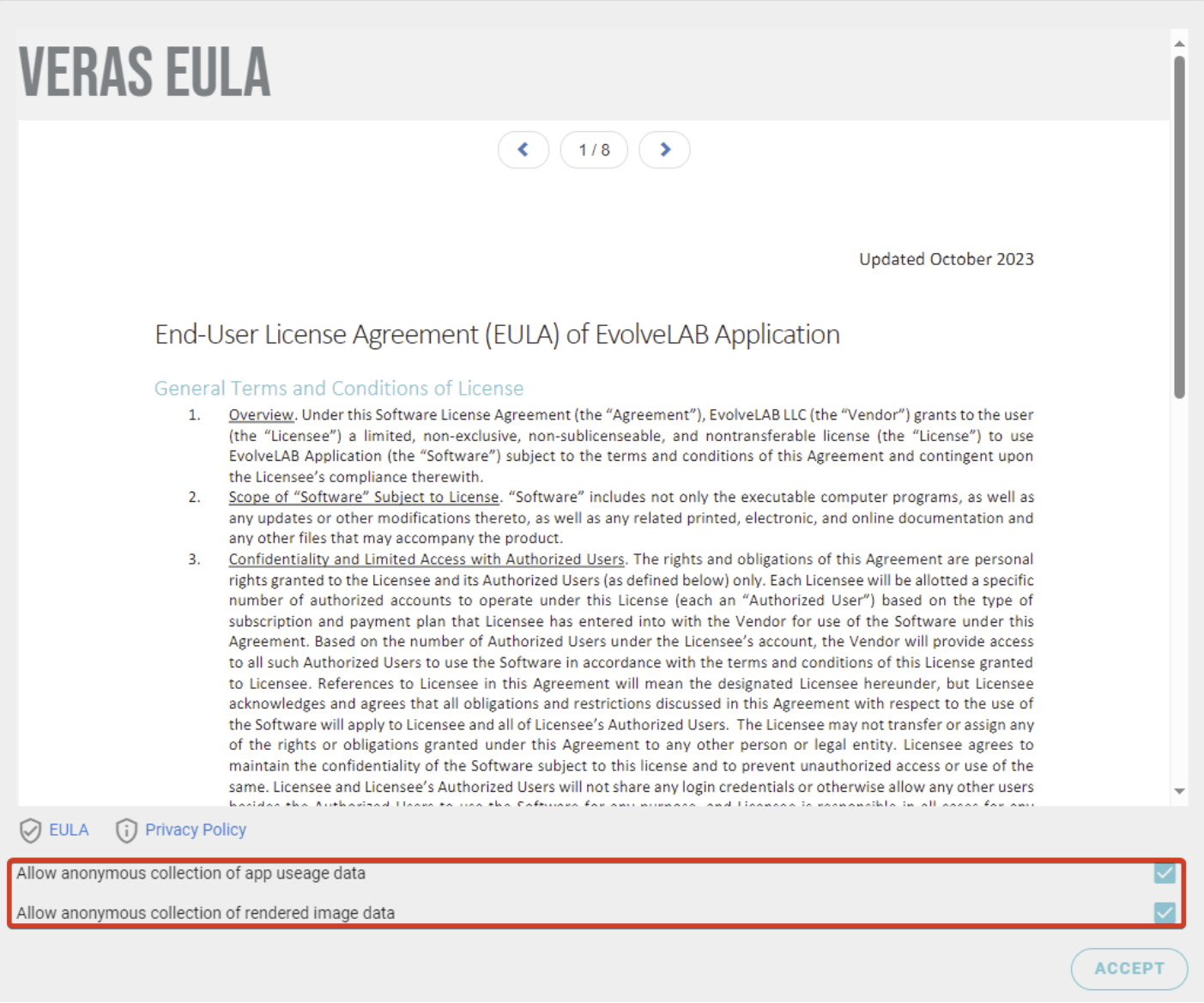

Para o Veras e o Glyph, os dados anônimos de renderização e de uso só são coletados se você optar por compartilhá-los. Você pode desativar a opção durante a instalação ou globalmente para o Veras e o Glyph via nosso guia de configuração de TI. Para o AI Enhancer, as imagens anonimizadas de entrada e saída são armazenadas somente para fins de garantia de qualidade e diagnóstico.

Desde que seja permitido por seus contratos e que você siga as regras para quaisquer modelos ou ativos de terceiros que use.

A Chaos não reivindica a propriedade dos seus resultados.

Nossas ferramentas de IA incentivam a autoria humana. Elas simplificam o seu processo criativo usando seus dados de entrada, permitindo que você escolha a seed, os prompts, os controles e os resultados, preservando a contribuição humana necessária para a defesa dos direitos autorais sob a legislação dos EUA.

Cada funcionalidade de IA que desenvolvemos reflete nosso compromisso com a justiça, a segurança e a responsabilidade, sem comprometer o avanço da inovação. Esses princípios não têm papel secundário, mas sim moldam nossa filosofia de produto do começo ao fim.

Ética nos dados de treinamento.

Coletamos os dados de treinamento com cuidado, usando conjuntos de dados selecionados, feitos para atender às necessidades únicas da visualização arquitetônica. Em vez de coletar dados da Web pública indiscriminadamente, usamos conteúdo devidamente licenciado e relevante para o contexto que reflete padrões profissionais e diversas abordagens de design. Nossa meta é inspirar a criatividade sem comprometer a integridade.

Qualidade através da testagem contínua.

Antes do lançamento, toda funcionalidade de IA passa por testes rigorosos, tanto de sistemas automatizados quanto da revisão manual humana. E esse processo não acaba após o lançamento. Continuamos avaliando o desempenho no mundo real para garantir que os resultados permaneçam confiáveis, complexos e alinhados às expectativas dos usuários.

Supervisão ética por padrão.

Cada recurso de IA que criamos passa por um processo de revisão estruturado, conciliando a avaliação técnica com perspectivas humanas diversas. Isso nos ajuda a identificar de forma proativa riscos como parcialidade e declarações falsas, bem como a moldar ferramentas que atendam a um amplo espectro de usuários com integridade, ética e zelo.

O feedback como força norteadora.

Sua opinião tem um papel central no nosso aprimoramento. Os fóruns da comunidade, os programas alfa e beta, contatos diretos com clientes e mesas-redondas nos ajudam a continuar em sintonia com suas experiências. Esse diálogo contínuo garante que nossa IA evolua de acordo com as suas necessidades e preserve a relação com a realidade.

Com a integração cada vez maior da IA aos fluxos de trabalho de design e visualização, entendemos como se tornou essencial a transparência em relação à propriedade intelectual e à segurança de dados. Elaboramos estas perguntas frequentes para explicar com clareza como os seus dados são gerenciados e quais direitos você retém ao trabalhar com ferramentas com tecnologia de IA do Chaos.

Consideram-se nossas três principais ferramentas de IA:

Para cada ferramenta, você encontrará um detalhamento de duas áreas críticas: a propriedade intelectual por trás dos dados de treinamento e as medidas adotadas para proteger os seus dados durante o uso. Nosso objetivo é proporcionar confiança e clareza enquanto você descobre como a IA pode contribuir com seu processo criativo. Caso tenha outras dúvidas, entre em contato conosco. Estamos à disposição para ajudar!

De acordo com o Departamento de Direitos Autorais dos EUA, o conteúdo gerado por IA pode ser protegido por direitos autorais quando há contribuição ou edições significativas de um ser humano na imagem: Leia as orientações oficiais aqui. O Veras usa o seu modelo 3D e visão de câmera como base visual ("substrato") para a renderização, o que implica que o resultado é baseado diretamente no seu conteúdo autoral. Você também faz a contribuição humana por meio da criação de prompts, do bloqueio de seed e da seleção de renderização, o que torna o processo coautoral. Esses componentes de interação humana, inerentes ao uso do Veras, garantem que qualquer resultado esteja de acordo com os requisitos para conteúdo passível de proteção de direitos autorais estabelecidos pelas diretrizes do Escritório de Direitos Autorais dos Estados Unidos.

Na UE, o foco está na originalidade do trabalho. Diferentes países podem ter em vigor limites distintos sobre o que se qualifica como originalidade criativa ou interação humana suficiente. Então, embora o envolvimento humano seja essencial, o tratamento jurídico específico pode divergir entre os países.

Asseguramos que a Chaos não reivindica a propriedade dos resultados que você criar usando o Veras. Porém, podemos reter certos direitos limitados de uso desses resultados, principalmente para operar e aprimorar nossos produtos e serviços. Além disso, podemos impor certas limitações ao uso dos nossos produtos, serviços e conteúdo (por exemplo, proibindo usos que violem a legislação aplicável ou que envolvam representações físicas do nosso conteúdo proprietário). Consulte o texto exato em nosso Contrato de Licença e Serviços.

Seus direitos sobre os resultados dependerão de vários fatores, particularmente do contexto em que a renderização foi criada (por exemplo, de modo independente, como uma atribuição de trabalho ou sob um contrato de cliente), bem como de quaisquer direitos de terceiros sobre o modelo subjacente ou os ativos usados.

O Veras é alimentado pelo Stable Diffusion, que é treinado com o conjunto de dados do LAION, um conjunto de dados de larga escala de imagens e textos disponíveis publicamente, compilados de fontes da Internet.

Não. Os resultados gerados pelo Veras não são uma reprodução de nenhuma imagem de treinamento específica. O modelo gera conteúdo totalmente novo baseado na estrutura do seu design 3D e na orientação textual que você fornecer. Desde que a entrada seja sua, o resultado também será seu.

O Veras envia apenas dados essenciais (visão da câmera e instantâneo da geometria) à nuvem para a renderização.

Você. O AI Enhancer aplica melhorias visuais às suas renderizações. Como ele não introduz conteúdo novo nem altera a intenção do seu design, a propriedade intelectual permanece sendo totalmente sua.

O AI Enhancer é alimentado pelo Stable Diffusion, que é treinado com o conjunto de dados do LAION, um conjunto de dados de larga escala com imagens e textos disponíveis publicamente, compilados de fontes da Internet, e com técnicas de processamento de imagem de código aberto, como remoção de ruídos e aprimoramento de detalhes. Ele não é treinado com conteúdo gerado por usuários, nem introduz qualquer imagem externa.

Armazenamos as imagens de entrada e saída nos Estados Unidos. Elas são usadas apenas para fins de garantia de qualidade e diagnóstico, conforme o CLUF. Esses dados não são usados para treinamento, e não há planos de realizar tal uso no futuro.

Você. O Glyph funciona totalmente no seu ambiente BIM, gerando resultados (visualizações, plantas, marcações e dimensões) baseados no seu modelo. Os prompts e as entradas de usuário geram os resultados, e todas as saídas permanecem no seu projeto e sob o seu controle.

O Glyph Copilot usa o ChatGPT (GPT-4) da OpenAI para auxiliar na execução de tarefas e pacotes do Glyph. O LLM é treinado em uma ampla variedade de dados da Internet disponíveis publicamente e não incorpora conteúdo de clientes.

O Glyph não retém nem refina o modelo usando os seus dados.

Não. Porém, no CLUF, reservamos a opção de fazê-lo no futuro. Ao iniciar o app pela primeira vez, há duas caixas de seleção que você pode desativar caso não queira permitir a coleta anônima de imagens, prompts e dados de uso do app.

Para desativar globalmente essa opção, profissionais de TI podem seguir estas instruções: https://forum.evolvelab.io/t/installing-veras-msi-configurations-remote-deployment-for-it-managers/4717