Unser Konzept bei der generativen KI basiert auf einem tiefen Respekt vor menschlicher Kreativität. Wir sind der Auffassung, dass KI den Menschen nicht ersetzen, sondern unterstützen soll. Daher haben wir uns bei der Entwicklung entsprechender Lösungen zu verantwortungsvoller, kreativer Innovation verpflichtet.

Wir bei Chaos sind der Ansicht, dass KI die menschliche Kreativität fördern und nicht etwa ersetzen sollte. Unsere KI-Tools unterstützen Architekten, Ingenieure, Auftragnehmer und bildende Künstler mit Funktionen, die die Fantasie und Effizienz steigern und gleichzeitig die Urheberschaft und Originalität schützen.

Da sich generative KI im Design und in der Visualisierung immer mehr durchsetzt, ist unsere Verpflichtung eindeutig: Innovation ohne Kompromisse fördern – mit Respekt vor den Urhebern, Schutz des geistigen Eigentums sowie rechtlicher und ethischer Klarheit bei jedem Schritt.

Wir haben unsere KI als Co-Creation-Plattformen konzipiert, auf denen Fachleute die Kontrolle über die KI haben und gleichzeitig deren Leistungsfähigkeit nutzen können. KI soll die Kreativität verstärken, anstatt sie zu beeinträchtigen.

So sorgen wir dafür, dass unser Konzept durchdacht, verantwortungsbewusst und auf Kreativität ausgerichtet ist:

Veras und Chaos AI Enhancer arbeiten mit Stable Diffusion, das auf Bilderpaaren und Beschriftungen aus LAION-5B trainiert wurde – einem öffentlich zugänglichen Datensatz, der aus internetbasierten Common Crawl-Daten stammt. Für andere Modelle verwenden wir nur Datensätze, die quelloffen und für die kommerzielle Nutzung geeignet sind oder für die wir eine entsprechende Lizenz erhalten haben.

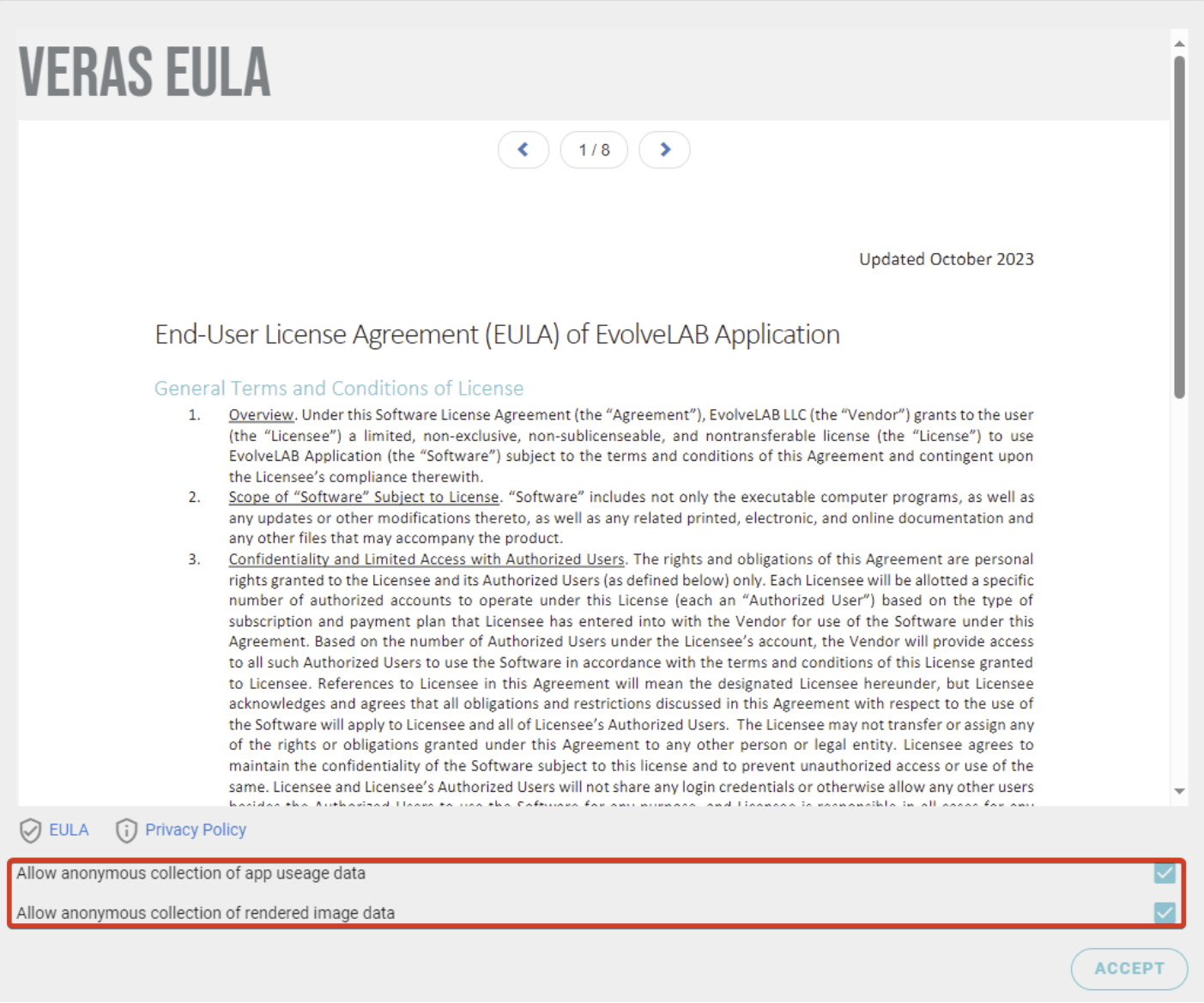

Für Veras und Glyph werden anonyme Rendering- und Nutzungsdaten nur dann erfasst, wenn Sie sich dafür entscheiden, sie weiterzugeben. Sie können diese Einstellung während der Einrichtung oder global für Veras und Glyph über unseren IT-Konfigurationsleitfaden deaktivieren. Für den AI Enhancer werden anonymisierte Input- und Output-Bilder nur zu Qualitätssicherungs- und Diagnosezwecken gespeichert.

Voraussetzung hierfür ist, dass Ihre Verträge dies zulassen und Sie die Regeln für die von Ihnen genutzten Drittanbieter-Modelle oder -Assets einhalten.

Chaos beansprucht nicht das Eigentum an Ihrem Output.

Unsere KI-Tools fördern die menschliche Urheberschaft. Sie optimieren Ihren kreativen Prozess, indem sie Ihre Eingabedaten verwenden und Ihnen die Wahl des Seeds, der Prompts, der Kontrollen und der Ausgaben überlassen. Dabei bleibt der menschliche Input erhalten, der nach US-Recht für den Urheberrechtsschutz erforderlich ist.

Jede von uns entwickelte KI-Funktion spiegelt unser Engagement für Fairness, Sicherheit und Verantwortlichkeit wider, ohne Innovationen zu bremsen. Diese Grundsätze sind keine Nebensache, sondern prägen unsere Produktphilosophie von Grund auf.

Ethische Trainingsdaten.

Wir nutzen sorgfältig kuratierte Datensätze, die auf die besonderen Anforderungen der Architekturvisualisierung abgestimmt sind. Anstatt wahllos aus öffentlichen Websites zu schöpfen, setzen wir auf ordnungsgemäß lizenzierte, kontextrelevante Inhalte, die professionellen Standards und vielfältigen Designanforderungen entsprechen. Unser Ziel: Kreativität fördern, ohne die Integrität zu gefährden.

Qualität durch kontinuierliche Tests.

Bevor eine KI-Funktion freigegeben wird, wird sie rigoros getestet – sowohl durch automatisierte Systeme als auch durch Menschen, die sie ausprobieren. Dieser Prozess ist aber mit der Markteinführung noch nicht abgeschlossen. Wir bewerten laufend die Leistung in der Praxis, damit die die Ergebnisse stets zuverlässig und differenziert sind und den Erwartungen der Benutzer entsprechen.

Ethische Kontrolle von Anfang an.

Jede KI-Fähigkeit, die wir entwickeln, durchläuft einen strukturierten Prüfprozess. Dabei wird die technische Bewertung mit verschiedenen menschlichen Perspektiven in Einklang gebracht. Dies hilft uns, Risiken wie Voreingenommenheit oder falsche Darstellungen proaktiv zu erkennen und Tools zu entwickeln, die mit Fairness, Ethik und Sorgfalt für ein breites Benutzerspektrum bereitgestellt werden.

Feedback als treibende Kraft.

Mit Ihrer Meinung tragen Sie wesentlich zu Verbesserungen auf unserer Seite bei. Durch Community-Foren, Alpha- und Beta-Programme sowie gezielte Kundenansprache und Gesprächsrunden sind wir jederzeit darüber im Bilde, welche Erfahrungen Sie machen. Durch diesen ständigen Dialog wird sichergestellt, dass sich unsere KI mit Ihren Anforderungen weiterentwickelt und auf dem Boden der Realität bleibt.

Da KI zunehmend in Design- und Visualisierungs-Workflows integriert wird, wissen wir, wie wichtig heutzutage Transparenz im Hinblick auf geistiges Eigentum und Datensicherheit ist. Diese FAQ sollen verdeutlichen, wie Ihre Daten verwaltet werden und welche Rechte Sie haben, wenn Sie mit KI-gestützten Tools von Chaos arbeiten.

Wir berücksichtigen dabei unsere drei wichtigsten KI-Tools:

Zu jedem Tool finden Sie eine Aufschlüsselung zweier kritischer Bereiche: das geistige Eigentum hinter den Schulungsdaten und die Maßnahmen, die zur Sicherung Ihrer Daten während der Nutzung dienen. Unser Ziel ist es, Ihnen Sicherheit und Klarheit zu verschaffen, während Sie die Möglichkeiten der KI in Ihrem kreativen Prozess erkunden. Falls Sie weitere Fragen haben, wenden Sie sich einfach an uns. Wir helfen Ihnen gern weiter!

Laut U.S. Copyright Office können KI-generierte Inhalte urheberrechtlich geschützt werden, wenn ein Mensch zu dem Bild beiträgt oder es sinnvoll oder maßgeblich bearbeitet: Lesen Sie den offiziellen Leitfaden hier. Veras nutzt Ihr 3D-Modell und Ihre Kameraansicht als visuelle Grundlage („Substrat“) für das Rendering, d. h. der Output basiert direkt auf den von Ihnen erstellten Inhalten. Auch durch das Erstellen von Prompts, das Sperren von Seeds und die Auswahl von Renderern leisten Sie einen menschlichen Beitrag, sodass der Prozess von Ihnen mitgestaltet wird. Durch diese Komponenten des menschlichen Inputs, die mit der Nutzung von Veras einhergehen, erfüllt jeder Output die Anforderungen an urheberrechtsfähige Inhalte gemäß den Richtlinien des United States Copyright Office.

In der EU liegt der Schwerpunkt eher auf der Originalität oder Ursprünglichkeit des Werks. Je nach Land kann sich die Schwelle dessen, was als ausreichender menschlicher Input oder kreative Originalität gilt, leicht unterscheiden. Auch wenn die menschliche Beteiligung von entscheidender Bedeutung ist, kann die genaue rechtliche Behandlung von Land zu Land unterschiedlich sein.

Wir können Ihnen versichern, dass Chaos keinen Anspruch auf den Output erhebt, den Sie mit Veras erstellt haben. Wir behalten uns jedoch bestimmte eingeschränkte Rechte zur Nutzung dieses Outputs vor – in erster Linie zur Ausführung und Verbesserung unserer Produkte und Dienstleistungen. Darüber hinaus können wir für die Nutzung unserer Produkte, Dienstleistungen und Inhalte bestimmte Beschränkungen festlegen (etwa das Verbot von Nutzungen, die gegen geltendes Recht verstoßen oder das Erstellen physischer Darstellungen unserer geschützten Inhalte beinhalten). Den genauen Wortlaut finden Sie in unserem Lizenz- und Servicevertrag.

Ihre Rechte am Output hängen von mehreren Faktoren ab, insbesondere vom Kontext, in dem das Rendering erstellt wurde (z. B. unabhängig, im Zuge Ihres Beschäftigungsverhältnisses oder im Rahmen eines Kundenvertrags), sowie von etwaigen Rechten Dritter am zugrunde liegenden Modell oder den verwendeten Assets.

Veras basiert auf Stable Diffusion, das mit dem LAION-Datensatz trainiert wurde – einem umfassenden, öffentlich zugänglichen Bild-Text-Datensatz, der aus Internetquellen zusammengestellt wurde.

Nein. Der von Veras erzeugte Output ist keine Reproduktion eines einzelnen Trainingsbildes. Das Modell generiert gänzlich neue Inhalte auf Grundlage der Struktur Ihres 3D-Entwurfs und Ihrer Textsteuerung. Solange der Input von Ihnen stammt, gehört auch der Output Ihnen.

Veras sendet nur die wichtigsten Daten (Kameraansicht und Geometrie-Snapshot) zum Rendering an die Cloud.

Sie. Der AI Enhancer nimmt visuelle Verbesserungen an Ihren eigenen Renderings vor. Es werden keine neuen Inhalte eingeführt oder Ihre Designabsicht geändert, sodass das geistige Eigentum vollständig bei Ihnen verbleibt.

Der AI Enhancer basiert auf Stable Diffusion, das mit dem LAION-Datensatz trainiert wurde – einem umfassenden, öffentlich zugänglichen Bild-Text-Datensatz, der aus Internetquellen zusammengestellt wurde. Eine weitere Grundlage sind Open-Source-Bildverarbeitungstechniken wie Denoising und Detailoptimierung. Es wird nicht auf nutzergenerierte Inhalte trainiert und führt keine externen Bilder ein.

Wir speichern die Input- und Outputbilder in den USA und nutzen sie ausschließlich zu Qualitätssicherungs- und Diagnosezwecken, wie in der EULA beschrieben. Diese Daten werden nicht zum Trainieren verwendet. Es ist auch nicht geplant, sie künftig zu Trainingszwecken zu nutzen.

Sie. Glyph arbeitet vollständig innerhalb Ihrer BIM-Umgebung und erzeugt Output (Ansichten, Sheets, Tags und Dimensionen) auf Grundlage Ihres Modells. Prompts und Benutzereingaben steuern die Ergebnisse, und der gesamte Output bleibt in Ihrem Projekt und unter Ihrer Kontrolle.

Glyph Copilot nutzt ChatGPT (GPT-4) von OpenAI zur Unterstützung bei der Ausführung der Glyph-Aufgaben und -Bundles. Das LLM wird mit breit gefächerten, öffentlich zugänglichen Internetdaten trainiert. Kundeninhalte werden dabei nicht integriert.

Glyph führt kein Retraining und keine Feinabstimmung des Modells anhand Ihrer Daten durch.

Nein, aber in der EULA behalten wir uns die Möglichkeit vor, dies in Zukunft zu tun. Sie können zwei Kontrollkästchen deaktivieren, wenn Sie das anonyme Sammeln von Bildern, Prompts und App-Nutzungsdaten beim ersten Start der App untersagen möchten.

Um diese Funktion auf globaler Ebene zu deaktivieren, können IT-Experten den hier beschriebenen Anweisungen folgen: https://forum.evolvelab.io/t/installing-veras-msi-configurations-remote-deployment-for-it-managers/4717