Il nostro approccio all'IA generativa si basa su un profondo rispetto per la creatività umana. L'obiettivo è potenziare le persone, non sostituirle, e ci impegniamo per un'innovazione responsabile e incentrata su chi crea contenuti.

Noi di Chaos crediamo che l'intelligenza artificiale debba migliorare la creatività umana, non sostituirla. I nostri strumenti di IA sono progettati per supportare architetti, ingegneri, appaltatori e visual artist con funzionalità che amplificano l'immaginazione e l'efficienza, proteggendo al contempo la titolarità e l'originalità.

Poiché l'intelligenza artificiale generativa sta diventando una presenza fissa nella progettazione e nella visualizzazione, il nostro impegno è chiaro: promuovere l'innovazione senza compromessi, rispettando chi crea contenuti, salvaguardando la proprietà intellettuale e fornendo chiarezza legale ed etica in ogni fase del processo.

Abbiamo progettato la nostra intelligenza artificiale sotto forma di piattaforme di co-creazione, dando ai professionisti il controllo quando sfruttano le potenzialità dell'IA. È costruita per amplificare la creatività, non per comprometterla.

Ecco come garantiamo che il nostro approccio rimanga ponderato, responsabile e incentrato sulle persone:

Veras e Chaos AI Enhancer utilizzano Stable Diffusion, che è stato addestrato su coppie di immagini e didascalie prese da LAION-5B, un set di dati disponibile al pubblico derivato da dati Common Crawl raccolti dal web. Per altri modelli utilizziamo solo set di dati open source e idonei all'uso commerciale o che sono stati correttamente concessi in licenza per il nostro uso.

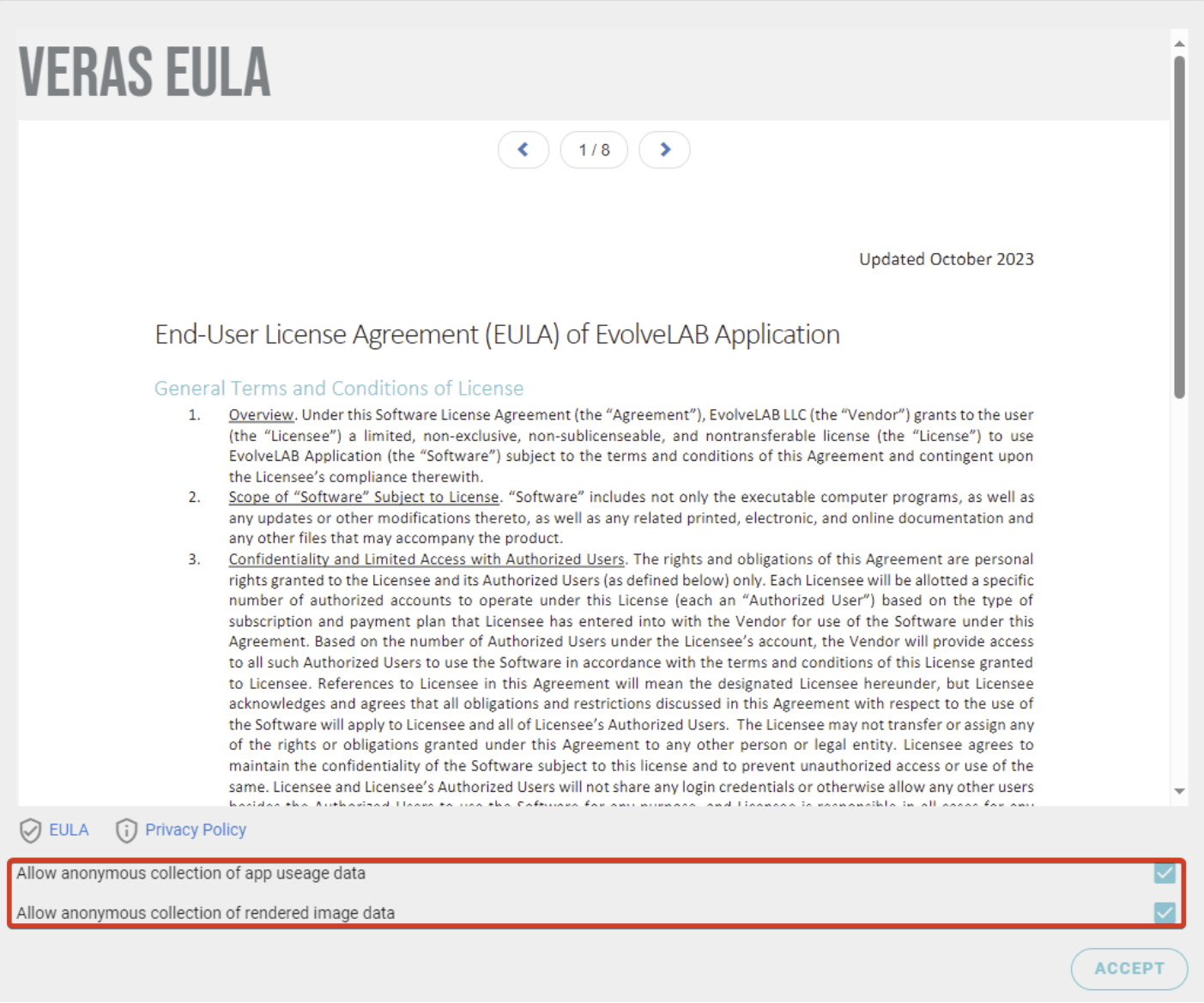

Per Veras e Glyph, i dati di rendering e utilizzo anonimi vengono raccolti solo se scegli di condividerli. Puoi disabilitare questa opzione durante la configurazione o globalmente per Veras e Glyph tramite la nostra guida alla configurazione IT. Per AI Enhancer, le immagini di input e output anonime vengono archiviate solo per scopi diagnostici e di controllo qualità.

L'importante è che i tuoi contratti lo consentano e che tu segua le regole per tutti i modelli o gli asset di terze parti che utilizzi.

Chaos non rivendica la proprietà dei tuoi output.

I nostri strumenti di intelligenza artificiale incoraggiano la titolarità umana e semplificano il processo creativo, utilizzando i dati di input e consentendoti di scegliere il modello, i prompt, i controlli e gli output, ma preservando al contempo l'input umano richiesto per la protezione del copyright ai sensi della legge statunitense.

Ogni funzionalità di intelligenza artificiale che progettiamo rispecchia il nostro impegno per la correttezza, la sicurezza e la responsabilità, senza compromettere il ritmo dell'innovazione. Questi principi non restano ai margini, ma danno forma alla nostra filosofia di prodotto fin dalle fasi iniziali.

Dati di addestramento etici.

Reperiamo i dati di addestramento con cura, utilizzando set di dati selezionati progettati per supportare le esigenze specifiche della visualizzazione architettonica. Anziché attingere indiscriminatamente al web pubblico, ci basiamo su contenuti con una licenza adeguata e pertinenti al contesto che rispecchiano standard professionali e diverse sensibilità progettuali. Il nostro obiettivo è ispirare la creatività senza compromettere l'integrità.

Qualità garantita da test continui.

Prima di essere rilasciate, tutte le funzionalità di intelligenza artificiale vengono rigorosamente testate, sia attraverso sistemi automatizzati che tramite una revisione umana pratica. Questo processo non termina al momento del lancio: continuiamo a valutare le prestazioni nel mondo reale per fare in modo che i risultati rimangano affidabili, sfumati e in linea con le aspettative degli utenti.

Supervisione etica fin dalla progettazione.

Ogni funzionalità di intelligenza artificiale che sviluppiamo viene sottoposta a un processo di revisione strutturato, trovando un equilibrio tra la valutazione tecnica e le diverse prospettive umane. Questo ci aiuta a identificare proattivamente rischi come pregiudizi o distorsioni e a definire strumenti adatti a un ampio spettro di utenti in modo equo, etico e attento.

Feedback usati come guida.

La tua opinione svolge un ruolo centrale per il nostro miglioramento. I forum della community, i programmi alfa e beta, le attività di sensibilizzazione e le tavole rotonde mirate ai clienti ci consentono di rimanere in contatto con le tue esperienze. Questo dialogo continuo garantisce che la nostra intelligenza artificiale si evolva insieme alle tue esigenze e rimanga radicata nella realtà

.L'intelligenza artificiale è sempre più integrata nei flussi di lavoro di progettazione e visualizzazione e questo ci consente di comprendere quanto sia diventata essenziale la trasparenza in materia di proprietà intellettuale e sicurezza dei dati. Queste domande frequenti sono progettate per spiegare chiaramente come vengono gestiti i tuoi dati e quali diritti conservi quando lavori con gli strumenti basati sull'intelligenza artificiale di Chaos.

Copriamo i nostri tre strumenti chiave di intelligenza artificiale:

Per ogni strumento, troverai un'analisi di due aree critiche: la proprietà intellettuale alla base dei dati di addestramento e le misure in atto per proteggere i tuoi dati durante l'uso. Il nostro obiettivo è darti sicurezza e chiarezza mentre esplori ciò che l'IA ti consente di fare durante il processo creativo. Se hai ulteriori domande, non esitare a contattarci: saremo lieti di aiutarti!

Secondo lo U.S. Copyright Office, i contenuti generati dall'intelligenza artificiale possono essere protetti da copyright quando un essere umano contribuisce o modifica in modo significativo l'immagine: leggi le linee guida ufficiali qui. Veras utilizza il modello 3D e la vista della telecamera come base visiva ("substrato") per il rendering, il che significa che l'output si basa direttamente sui contenuti da te creati. Inoltre, fornisci input umani tramite la creazione di prompt, il blocco dei modelli e la selezione del rendering, che fanno di te il co-autore del processo. Questi componenti di input umani, parte integrante dell'uso di Veras, allineano fermamente qualsiasi output ai requisiti relativi ai contenuti protetti da copyright delle linee guida dell'Ufficio del copyright degli Stati Uniti.

Nell'UE, l'attenzione si concentra maggiormente sull'originalità dell'opera. Paesi diversi possono applicare soglie leggermente diverse per ciò che si qualifica come contributo umano sufficiente o originalità creativa. Quindi, sebbene il coinvolgimento umano sia fondamentale, l'esatto trattamento legale può variare da paese a paese.

Possiamo assicurarti che Chaos non rivendica la proprietà degli output che crei utilizzando Veras. Tuttavia, possiamo conservare alcuni diritti limitati sull'utilizzo di tali output, principalmente per gestire e migliorare i nostri prodotti e servizi. Inoltre, potremmo imporre alcune limitazioni all'uso dei nostri prodotti, servizi e contenuti (ad esempio, vietando gli usi che violano le leggi applicabili o che implicano la creazione di materializzazioni fisiche dei nostri contenuti proprietari). Puoi trovare la formulazione esatta nel nostro Contratto di licenza e servizi.

I tuoi diritti sugli output dipendono da diversi fattori, in particolare dal contesto in cui il rendering è stato creato (ad es., in modo indipendente, nell'ambito del tuo rapporto di lavoro o in base a un contratto con un cliente), nonché da eventuali diritti di terzi sul modello alla base o sulle risorse utilizzate.

Veras è basato su Stable Diffusion, che viene addestrato sul set di dati LAION, un set di dati immagine-testo su larga scala e disponibile al pubblico compilato da fonti Internet.

No. L'output generato da Veras non è una riproduzione di una singola immagine di addestramento. Il modello genera contenuti completamente nuovi in base alla struttura del tuo progetto 3D e alla guida testuale. Se l'input è tuo, anche l'output lo è.

Veras invia al cloud solo i dati essenziali per il rendering (vista della telecamera e istantanea della geometria).

Tu. AI Enhancer applica miglioramenti visivi ai tuoi rendering, ma non inserisce nuovi contenuti né altera l'intento progettuale, quindi la proprietà intellettuale rimane interamente tua.

AI Enhancer è basato su Stable Diffusion, che è addestrato sul set di dati LAION, un set di dati immagine-testo su larga scala e disponibile al pubblico compilato da fonti Internet, e su tecniche di elaborazione delle immagini open source, come la rimozione delle interferenze e il miglioramento dei dettagli. Non è addestrato su contenuti generati dagli utenti e non inserisce immagini esterne.

Archiviamo le immagini di input e output negli Stati Uniti e le utilizziamo solo per scopi diagnostici e di controllo qualità, in base al nostro CLUF. Questi dati non vengono utilizzati per l'addestramento e non pianifichiamo di farlo in futuro.

Tu. Glyph funziona interamente all'interno del tuo ambiente BIM, producendo output (viste, fogli, tag e dimensioni) in base al tuo modello. I prompt e gli input degli utenti determinano i risultati e tutto l'output rimane all'interno del progetto e sotto il tuo controllo.

Glyph Copilot utilizza ChatGPT (GPT-4) di OpenAI per facilitare l'esecuzione delle attività e dei pacchetti Glyph. Il modello linguistico di grandi dimensioni è addestrato su un'ampia gamma di dati Internet disponibili al pubblico e non incorpora contenuti dei clienti

.Glyph non riaddestra o ottimizza il modello utilizzando i tuoi dati.

No, tuttavia, nel CLUF, ci riserviamo la possibilità di farlo in futuro. Ci sono due caselle di controllo che puoi disattivare se desideri impedire la raccolta anonima di immagini, prompt e dati sull'utilizzo dell'app al primo avvio dell'app.

Per disattivarla a livello globale, i professionisti IT possono seguire queste istruzioni: https://forum.evolvelab.io/t/installing-veras-msi-configurations-remote-deployment-for-it-managers/4717